Juli Savioli, una creadora de contenido con millones de seguidores, descubrió su imagen manipulada en videos pornográficos generados por inteligencia artificial. Su caso expone la escalada de una violencia digital sofisticada y la urgente batalla legal y social para recuperar el control sobre el propio cuerpo en la era de los deepfakes.

Un pensamiento obsceno, visceral, irrumpió en su mente al encontrarse por primera vez con una versión falsificada de sí misma en las profundidades de la red. “Esto es muy real”, recuerda haber musitado la influenciadora y humorista Juli Savioli. La impactante visión de su propio desnudo, publicado en una plataforma digital, generó en ella una conmoción profunda. “Me dio mucha impresión. Yo me cuido para que no aparezca nada”, explica. Reconocida por su carisma y su talento para satirizar escenas de la vida cotidiana, Savioli construyó una comunidad masiva en internet, compartiendo su creatividad y generando miles de interacciones. Sin embargo, ese ascenso en el universo digital que creía dominar se transformó en una pesadilla cuando perdió el dominio sobre su propia imagen.

El fenómeno estalló públicamente en octubre, cuando la artista denunció en un programa de streaming que su identidad había sido utilizada sin autorización para crear contenidos pornográficos sintéticos mediante inteligencia artificial. Su testimonio puso el foco sobre una problemática en alarmante expansión, que adquirió renovada notoriedad esta semana tras revelarse una falla de seguridad en Grok, la herramienta de IA de la red social X. Este error técnico permitió brevemente a usuarios generar deepfakes sexuales de cualquier persona, incluyendo menores de edad, desatando una polémica que forzó a la plataforma a restringir la función únicamente a suscriptores de pago, luego de que su propietario, Elon Musk, restara inicialmente gravedad al asunto.

Esta tecnología representa una evolución siniestra en las formas de violencia digital. Tradicionalmente, el acoso con material íntimo se basaba en la difusión no consentida de imágenes reales, un flagelo con consecuencias trágicas, como ilustran los casos de Ema Bondaruk y Belén San Román, cuyas muertes impulsaron proyectos legislativos contra la pornovenganza. No obstante, la inteligencia artificial ha añadido una capa de complejidad aterradora: ahora el material compartido puede ser completamente ficticio, pero verosímil. La batalla ya no es sólo contra la extorsión con imágenes reales, sino también contra montajes pornográficos hiperrealistas creados por algoritmos.

“Es la mejor herramienta para alguien que, en su imaginación, hace lo que quiere con vos”, afirma Savioli con crudeza. Los deepfakes funcionan mediante redes neuronales antagónicas que perfeccionan la falsificación hasta hacerla casi indistinguible de la realidad. Cuando esta capacidad se combina con modelos de lenguaje accesibles al público, los usos nocivos se multiplican, como quedó demostrado con las solicitudes obscenas dirigidas a Grok.

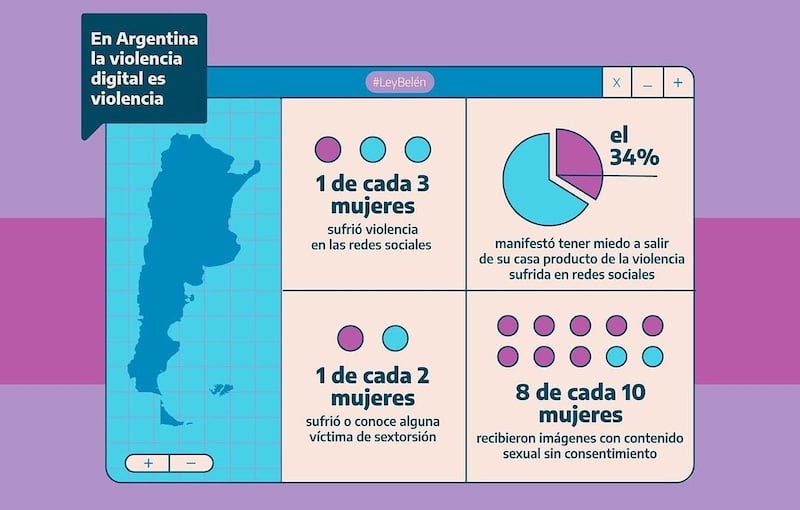

Frente a esta nueva realidad, surgen preguntas apremiantes: ¿cómo se recupera la soberanía sobre la propia imagen? Los caminos son múltiples y sinuosos. Se puede transitar la vía judicial, aunque las leyes suelen ir a la zaga de la tecnología. Organizaciones como TakeItDown o StopNCII ofrecen herramientas comunitarias para marcar y eliminar contenido abusivo de diversas plataformas. En Argentina, la Ley Olimpia, promulgada en 2023, significó un avance al incluir la violencia digital en la legislación de protección a las mujeres y habilitar medidas cautelares para la remoción de contenidos. Sin embargo, estas prácticas aún no están tipificadas expresamente como delito en el Código Penal.

La creatividad jurídica busca cerrar esa brecha. En Córdoba, un joven de 19 años fue procesado por crear y publicar deepfakes de sus compañeras de colegio, en un caso que sus abogados definen como un “leading case” o precedente fundamental. “Espero que sea el primer fallo que condene por lesiones graves en un contexto de violencia digital de manera clara y nítida”, expresa el letrado José D’Antona. A pesar de estos esfuerzos, el proceso para desindexar las imágenes de los buscadores puede demorar semanas, y el rastro digital del daño perdura.

El debate sobre cómo enfrentar esta crisis divide aguas. Para algunos especialistas, como el abogado Francisco Morell Otamendi, regular un mercado tecnológico tan dinámico es una quimera, y el foco debe estar en robustecer las leyes penales. En la vereda opuesta, legisladoras como Mónica Macha, impulsora del proyecto “Belén”, sostienen que es imperioso establecer reglas para las plataformas. “Tenemos que tener la intención de poder regular a las empresas en aquello que puede generar un daño”, afirma Macha, quien recuerda la fuerte presión de las grandes tecnológicas para diluir medidas de la Ley Olimpia que obligaban a remover contenidos, argumentando supuestas afectaciones a la libertad de expresión. “El límite de este derecho –precisa– es cuando se convierte la vida de una mujer en un horror”.

En medio de este panorama desafiante, la voz de Savioli emerge con una mezcla de resistencia y realismo. Para ella, el morbo y la violencia son una sombra constante de la exposición pública. “Siempre van a querer desnudarte, de cualquier manera”, reflexiona. Sin embargo, elige no retroceder. “Hay que hacerle frente a esta vulnerabilidad. Es la mejor manera de poder hacerle guerra a ese tipo de situaciones”, concluye, abogando por no abandonar los espacios digitales, sino por transformarlos desde dentro, aliándose a su potencial positivo mientras se denuncia y se combate su faceta más oscura. Su experiencia es un testimonio crudo de un conflicto que redefine los límites de la intimidad, la identidad y la justicia en el siglo XXI.